Por Hernán Ordiales

Este prototipo propone un experimento: utilizar inteligencia artificial no como reemplazo, sino como asistente creativo en la construcción de una obra audiovisual.

Retoma ideas del proyecto APICultor, donde un controlador físico permitía explorar grandes bases de datos de sonidos a partir de búsquedas descriptivas ¿Cómo? Manipulando valores asociados a descriptores relacionados con Music Information Retrieval (MIR), características extraídas automáticamente del audio que permiten analizar, clasificar o buscar sonidos con criterios como el timbre, ritmo o tonalidad. Actúan como representaciones numéricas que resumen información relevante sobre un sonido o una pieza musical.

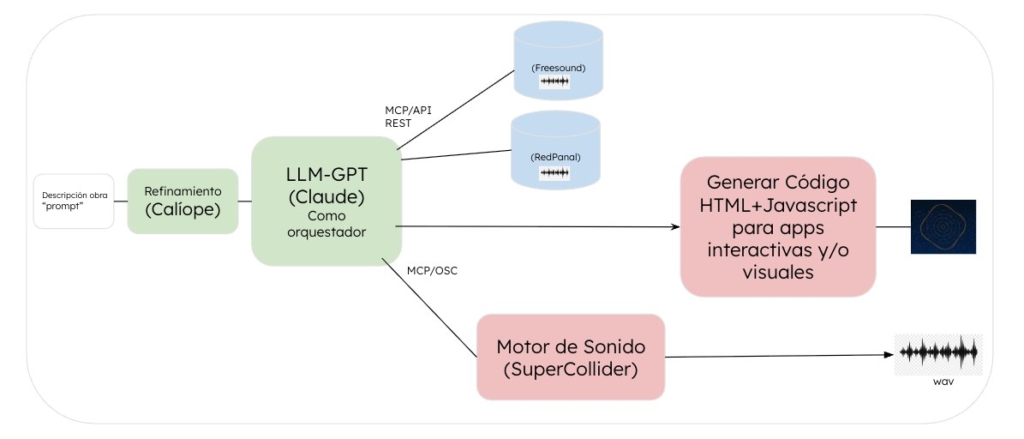

El flujo de trabajo que se propone es el que describe esta figura:

Se parte de un texto descriptivo, que actúa como partitura abierta: una narración sobre lo que debería suceder con el sonido a lo largo del tiempo. Esta lógica recuerda a ciertos compositores de música concreta, que no usaban pentagramas, sino instrucciones textuales sobre el carácter del sonido, más cerca de una imagen poética o de una receta que de una partitura tradicional. Los más detallistas mencionaban características tímbricas y dinámicas del sonido, en lugar de acordes o notas musicales. A partir de esa idea inicial, se utiliza Calíope, la interfaz generativa de LAIA, para expandir y refinar el texto. Luego, esa versión final se entrega a un modelo de lenguaje (como Claude Desktop), previamente configurado con “tools” o herramientas personalizadas vía MCP (Model Context Protocol), que le permiten interactuar con bases de sonidos como Freesound.org y RedPanal.org. Ambas plataformas ofrecen sonidos bajo licencias Creative Commons, habilitando usos libres y obras derivadas.

El modelo analiza el texto, interpreta sus indicaciones, y busca sonidos acordes. Si no encuentra coincidencias exactas, prueba estrategias alternativas: cambia de términos, ajusta los valores numéricos de los descriptores, o modifica el enfoque de búsqueda. Una vez que compila los sonidos, el sistema genera automáticamente código en SuperCollider para ensamblar y sintetizar la obra en base a los sonidos recuperados. Incluso, al mejor estilo “vibe coding”, puede generar unas visuales para acompañar la obra en cualquier navegador. Todo el proceso se basa en software libre y está disponible para quien quiera explorarlo o adaptarlo.

Acá se puede ver en un video:

Referencias